Znikające profile, nagłe usunięcia kont i sytuacje, gdy twórca lub lider społeczności z dnia na dzień traci dostęp do swojej publiczności, to zjawiska, które coraz częściej można zaobserwować w mediach społecznościowych. Dotyczą one szczególnie kontrowersyjnych i dezinformujących treści, które łamią regulaminy portali takich jak Facebook czy Instagram.

Tego typu przypadki nie są wyłącznie jednostkowymi decyzjami moderacyjnymi, lecz elementem większego mechanizmu zarządzania treściami w internecie. Określa się go mianem deplatformingu. To praktyka polegająca na usuwaniu użytkowników lub całych społeczności z platform cyfrowych. Pytanie tylko, czy jest to skuteczna metoda ograniczania szkodliwych zjawisk czy raczej mechanizm, który je przekształca i przenosi w mniej widoczne miejsca, gdzie trudniej nad nimi panować. Sprawdźmy to.

Wolność słowa a wolność zasięgu

Dyskusja o różnicy między wolnością słowa (freedom of speech) a wolnością zasięgu (freedom of reach) trwa od samych początków internetu, jeśli nie dłużej. Wolność słowa oznacza ochronę przed represjami za wyrażanie opinii. Według tego założenia nie powinno się karać ludzi za to, co mówią (z wyjątkiem sytuacji, gdy chodzi o groźby, zniesławienie czy nawoływanie do przemocy).

Takie założenie funkcjonuje w krajach demokratycznych. Przykładowo, w Konstytucji RP widnieje zapis: „Każdemu zapewnia się wolność wyrażania swoich poglądów oraz pozyskiwania i rozpowszechniania informacji”. W Polsce zakazana jest też cenzura prewencyjna, czyli taka, która odbywa się przed publikacją danej treści.

Wolność zasięgu to relatywnie nowe pojęcie, które wykształciło się wraz z rozwojem platform cyfrowych. Odnosi się do możliwości szerokiego rozpowszechniania wypowiedzi – docierania treści do odbiorców, obecności informacji w obiegu oraz widoczności kształtowanej przez algorytmy. Na tym tle ujawnia się zasadnicza różnica między wolnością zasięgu a wolnością słowa: wolność zasięgu to nie jest klasyczne prawo, lecz efekt decyzji infrastrukturalnych i redakcyjnych podejmowanych przez platformy.

W skrócie: wolność słowa oznacza, że możesz mówić. Wolność zasięgu – że inni muszą cię słuchać lub pomagać ci dotrzeć do słuchaczy.

Platformy cyfrowe takie jak X czy Facebook korzystają z narzędzi ograniczających wolność zasięgu w przypadku postów, które naruszają ich regulaminy.

Co jednak dzieje się w sytuacji, gdy ograniczenie zasięgu przestaje wystarczać, a konto użytkownika znika całkowicie z platformy? Wówczas mówimy o deplatformingu – praktyce, która wykracza poza moderację treści i dotyczy samej obecności jednostki w cyfrowej przestrzeni publicznej. To zjawisko budzi rosnące zainteresowanie badaczy zajmujących się mediami, prawem i naukami społecznymi, ponieważ ujawnia napięcia między regulacją, odpowiedzialnością platform a realnym dostępem do debaty publicznej.

Deplatforming – definicja i mechanizm działania

Deplatforming można zdefiniować jako usunięcie użytkownika, organizacji lub treści z platformy cyfrowej, często w wyniku naruszenia regulaminu lub polityki moderacyjnej danego portalu. W przeciwieństwie do ograniczania zasięgu postów (np. poprzez tzw. shadow banning) deplatforming jest działaniem o charakterze ostatecznym: w jego wyniku przestaje istnieć konto, a wraz z nim cała infrastruktura komunikacyjna, którą zbudował dany użytkownik.

Głośnym przypadkiem deplatformingu była decyzja o zbanowaniu Donalda Trumpa na Twitterze, Facebooku i innych mediach społecznościowych w styczniu 2021 roku. Działanie to spotkało się z różnymi opiniami: od komentarzy mówiących o cenzurze po pochwały działań deplatformingowych.

Istotne jest, że deplatforming nie dotyczy wyłącznie pojedynczych kont. Może obejmować całe społeczności czy ekosystemy składające się z treści uznawanych za niebezpieczne. Wówczas mamy do czynienia z tzw. łańcuchowym deplatformingiem, w ramach którego różne podmioty podejmują skoordynowane lub niezależne decyzje o wykluczeniu.

Do czego prowadzi deplatforming?

Konsekwencje deplatformingu są wielowymiarowe i zależą od kontekstu. Z jednej strony, badacze wskazują, że usuwanie kont szerzących treści ekstremistyczne może ograniczać zasięg takich materiałów i zdolność ich twórców do mobilizowania swojej publiczności w wybranym celu. Deplatforming redukuje widoczność, utrudnia rekrutację nowych odbiorców i fragmentaryzuje społeczności.

Z drugiej strony, zaobserwowano także zjawisko polegające na tym, że użytkownicy dotknięci deplatformingiem przenoszą się do mniej moderowanych przestrzeni, co może sprzyjać radykalizacji ich odbiorców. Zachodzi wtedy tzw. efekt kabiny pogłosowej, czyli zjawisko, w ramach którego użytkownicy mediów społecznościowych funkcjonują głównie w homogenicznych sieciach kontaktów i są eksponowani przede wszystkim na treści zgodne z ich poglądami. Użytkownicy migrują z najbardziej popularnych platform do tych mniej znanych, takich jak Telegram, Gab, Gettr czy BitChute.

Istotne jest także to, że usunięcie z platformy bywa interpretowane przez dotkniętych deplatformingiem użytkowników jako dowód prześladowania. Dzieje się tak dlatego, że sam akt wykluczenia łatwo wpisać w istniejące narracje o „uciszaniu niewygodnych głosów”. Dla odbiorców stanowi to pozornie namacalny dowód, że głoszona treść była „zbyt prawdziwa” lub „zbyt otwierająca oczy”, by mogła pozostać w głównym obiegu informacyjnym. W efekcie rośnie poczucie wspólnoty wokół osoby usuniętej z serwisu, a także poziom emocjonalnego zaangażowania jej zwolenników. Jednocześnie brak konfrontacji z szerszą, bardziej zróżnicowaną publicznością sprzyja zamykaniu się w jednorodnych środowiskach komunikacyjnych, co może prowadzić do dalszej radykalizacji postaw. Grupa odbiorców treści tworzonych przez daną osobę może stać się mniejsza, ale znacznie bardziej ekstremistyczna. W ujęciu systemowym deplatforming wpływa więc na strukturę debaty publicznej: nie eliminuje treści, lecz je przemieszcza i rekonfiguruje.

Deplatforming – studium przypadku

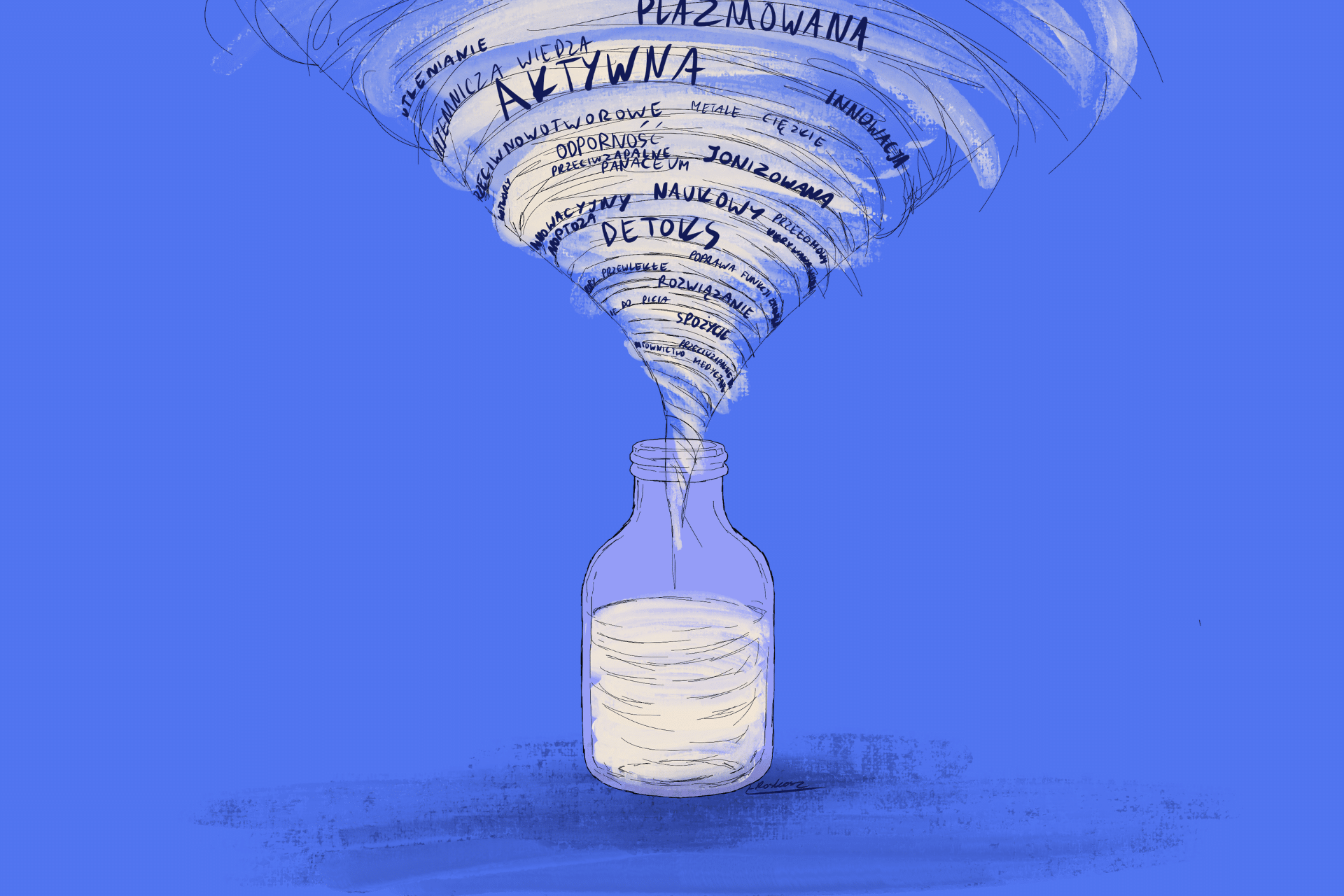

Jakiś czas temu podjęliśmy temat działalności Adama Dyszego i firmy PAW Water, która zajmuje się sprzedażą wody plazmowanej. Dyszy na prowadzonej przez niego na Facebooku grupie Autyzm – działamy skutecznie i na swoim profilu na tym portalu promował picie wody plazmowanej, ponieważ ma ona „leczyć autyzm” oraz pomagać z wieloma dolegliwościami zdrowotnymi. Brakuje na to dowodów naukowych, jednak nie ma to znaczenia dla internetowej działalności Dyszego.

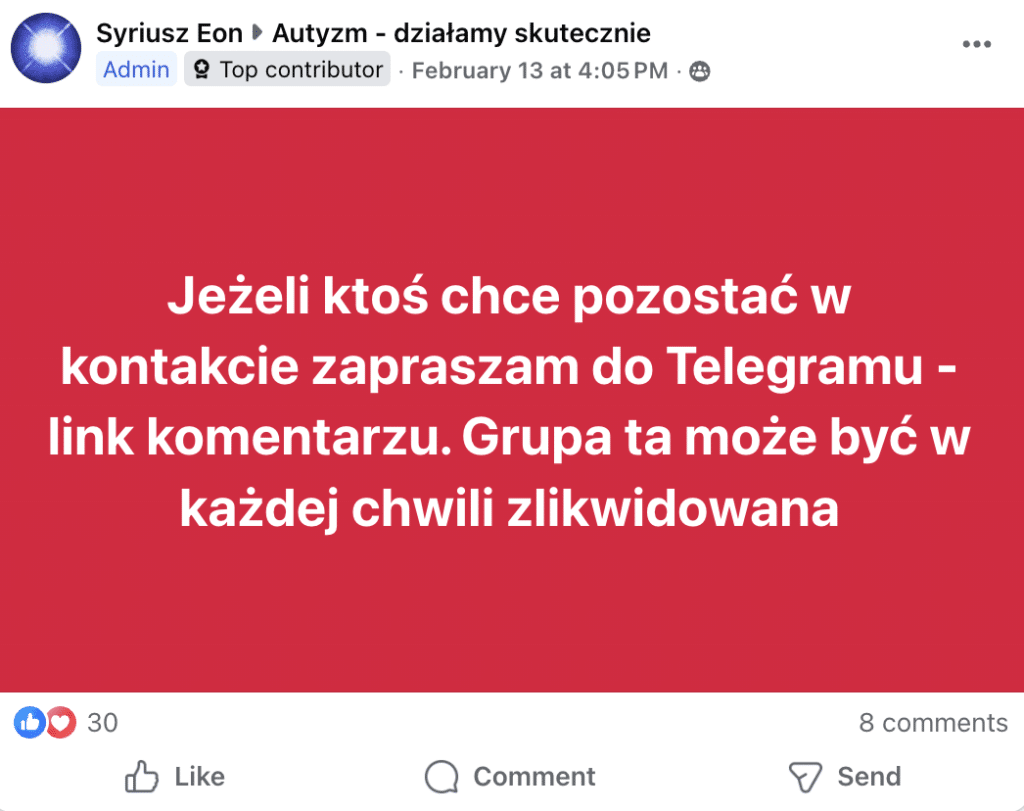

Jakiś czas po publikacji naszych artykułów strona Dyszego na Facebooku została usunięta. On sam jednak stworzył konto pod pseudonimem, dołączył z powrotem do grupy Autyzm – działamy skutecznie i zaczął zachęcać swoich zwolenników do przeniesienia się na Telegrama.

Nowa historia szerzona przez Dyszego jest podobna do mechanizmów opisanych w badaniach dotyczących deplatformingu. Naturopata tworzy narrację, według której jest prześladowany za „dążenie do prawdy”, jednak mimo to nie zaprzestanie realizacji swojej misji. Aby ją kontynuować, zdecydował się przenieść na Telegrama oraz otworzyć własną stronę internetową, na której opowiada o swojej działalności i buduje wizerunek siebie jako eksperta z zakresu biologii czy terapii poszczególnych przypadłości, w tym autyzmu. Dyszy wciąż unika jednak odpowiedzialności za udzielanie porad medycznych niezgodnych z konsensusem naukowym, co czyni na zamkniętych grupach.

To nie pierwsza sytuacja, kiedy Dyszy musiał zmienić ścieżkę komunikacji ze swoimi zwolennikami. Po tekście w „Newsweeku”, w którym opisano jego działalność, z przestrzeni internetowej zniknęła strona internetowa naturopaty, gdzie oferował szkolenia, warsztaty i konsultacje dla rodziców dzieci w spektrum autyzmu. Niedostępna jest też jego poprzednia grupa facebookowa, na której udzielał porad. Z czasem Dyszy powrócił na tę platformę. Jego aktualna grupa wciąż jest aktywna, równolegle do „grupy zapasowej” na Telegramie.

Podsumowanie

Deplatforming jest zjawiskiem, które w istotny sposób przekształca współczesną debatę publiczną. Choć jego bezpośrednim efektem jest ograniczenie zasięgu treści tworzonych przez danego użytkownika poprzez usunięcie go z platformy, konsekwencje tego procesu są znacznie bardziej złożone. Z jednej strony, stanowi on narzędzie służące do redukowania widoczności materiałów uznawanych za szkodliwe oraz ograniczania ich wpływu na szerokie grono odbiorców. Z drugiej, nie prowadzi do całkowitego zniknięcia użytkowników i społeczności, lecz raczej do ich relokacji – często do mniej regulowanych środowisk, w których internauci mogą ulegać dalszej radykalizacji.